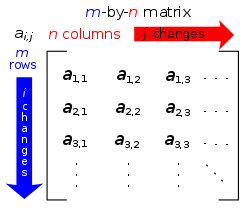

En matemáticas, una matriz (plural: matrices) es un rectángulo de números dispuestos en filas y columnas. Las filas son cada una de las líneas horizontales (de izquierda a derecha) y las columnas son las líneas verticales (de arriba abajo). La celda superior izquierda suele llamarse fila 1, columna 1. Una matriz con m filas y n columnas se denomina matriz de tamaño m × n (o dimensión m por n) y sus elementos se denotan habitualmente por aij, que es el elemento de la fila i y la columna j.

Las matrices suelen representarse con letras romanas mayúsculas como A {@displaystyle

Tipos comunes de matrices

- Matriz fila: una sola fila (1 × n).

- Matriz columna: una sola columna (m × 1).

- Matriz cuadrada: mismo número de filas y columnas (n × n).

- Matriz nula: todos sus elementos son cero.

- Matriz identidad In: matriz cuadrada con 1 en la diagonal principal y 0 en el resto; actúa como elemento neutro para la multiplicación.

- Matriz diagonal: ceros fuera de la diagonal principal.

- Matriz simétrica: A = AT (igual a su traspuesta).

Operaciones básicas

Suma y resta: dos matrices se pueden sumar o restar sólo si tienen las mismas dimensiones. La operación se realiza elemento a elemento: (A + B)ij = Aij + Bij.

Multiplicación por un escalar: multiplicar una matriz A por un número c significa multiplicar cada elemento de A por c: (cA)ij = c·Aij.

Multiplicación de matrices: el producto AB está definido cuando A es m × p y B es p × n; el resultado es una matriz m × n cuyo elemento (i,k) viene dado por la suma de productos:

(AB)ik = Σj=1p Aij·Bjk.

Esta regla implica que el orden importa y que la multiplicación es asociativa: (AB)C = A(BC), y distributiva respecto de la suma.

Traspuesta (AT): intercambia filas por columnas; si A es m × n, AT es n × m y (AT)ji = Aij. Propiedades útiles: (AT)T = A, (A + B)T = AT + BT, (AB)T = BTAT.

Propiedades especiales (cuadradas)

Determinante: número asociado a matrices cuadradas que, entre otras cosas, indica si la matriz es invertible (det ≠ 0). La calculación puede hacerse por expansión, eliminación gaussiana o descomposiciones (LU).

Inversa: una matriz cuadrada A tiene inversa A−1 si existe tal que AA−1 = A−1A = I. No todas las matrices cuadradas son invertibles.

Rango: número máximo de filas (o columnas) linealmente independientes; indica la dimensión de la imagen lineal asociada a la matriz.

Traza: suma de los elementos de la diagonal principal en una matriz cuadrada; la traza es invariante por conjugación (tr(ABA−1) = tr(B)).

Valores y vectores propios (autovalores y autovectores): para una matriz cuadrada A, un vector v ≠ 0 y un escalar λ tales que Av = λv. Los autovalores son fundamentales en diagonalización, estabilidad, modos normales y muchos algoritmos.

Matrices de más de dos dimensiones y tensores

En computación y aplicaciones puede hablarse de arreglos multidimensionales (por ejemplo, “matrices 3D”), pero en matemáticas estrictas estos objetos se suelen llamar tensores cuando generalizan las propiedades lineales de las matrices. Una matriz clásica es siempre bidimensional (filas × columnas).

Algoritmos y computación

En la práctica, las operaciones con matrices se realizan mediante algoritmos eficientes: eliminación de Gauss para resolver sistemas, descomposición LU, factorización QR, descomposición en valores singulares (SVD) y métodos iterativos para matrices grandes y dispersas. La complejidad y la estabilidad numérica son consideraciones importantes en cálculo numérico.

Aplicaciones

- Resolución de sistemas de ecuaciones lineales (método matricial de Ax = b).

- Informática: gráficos por ordenador (transformaciones lineales), representación de datos, aprendizaje automático (matrices de datos, pesos en redes neuronales).

- Física: tensores de esfuerzos, transformaciones de coordenadas y mecánica cuántica (operadores).

- Ingeniería: circuitos, análisis de estructuras y control.

- Economía y estadística: modelos econométricos, matrices de covarianza y análisis de datos.

- Teoría de grafos y redes: matrices de adyacencia y de incidencia.

Conceptos pedagógicos

En muchas universidades, los cursos sobre matrices se imparten en asignaturas de álgebra lineal y forman la base para numerosas disciplinas científicas y de ingeniería. Comprender el significado geométrico de operaciones como la multiplicación (por ejemplo, composición de transformaciones lineales) ayuda a interpretar resultados y a aplicar las matrices con criterio.

En resumen, las matrices son herramientas fundamentales para representar y manipular transformaciones lineales y conjuntos de datos estructurados; dominar sus operaciones y propiedades es clave en matemáticas aplicadas y ciencias cuantitativas.