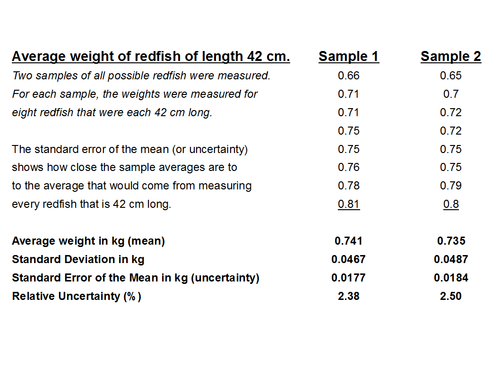

El error estándar es la desviación estándar de la distribución muestral de una estadística. Dicho de forma sencilla, indica cuánto puede variar una estadística, como la media, si se repite el muestreo muchas veces. También puede entenderse como una estimación de esa desviación estándar cuando solo se dispone de una muestra del grupo completo.

La media de una muestra se usa con frecuencia para estimar la media de toda una población, porque medir a todos los individuos suele ser costoso, lento o imposible. Sin embargo, si se toma otra muestra del mismo grupo, su media no será exactamente igual. El error estándar de la media ayuda a medir esa variación y muestra qué tan cerca podría estar la media muestral de la media real de la población.

Qué indica el error estándar

El error estándar no describe la dispersión de los datos originales, sino la precisión de una estimación. Por eso, cuanto menor es el error estándar, más fiable suele ser la estimación obtenida a partir de la muestra. En cambio, un error estándar grande indica que la estadística calculada puede cambiar bastante de una muestra a otra.

Este concepto es muy útil en estadística inferencial, porque permite valorar la incertidumbre asociada a estimaciones, intervalos de confianza y pruebas de hipótesis. En otras palabras, ayuda a responder preguntas como: ¿qué tan representativa es esta muestra? o ¿cuánta confianza puedo tener en este resultado?

Cálculo del error estándar

Cuando se trata del error estándar de la media, una forma habitual de calcularlo es la siguiente:

Error estándar de la media = desviación estándar / raíz cuadrada del tamaño de la muestra

Es decir, si la desviación estándar de los datos es s y el tamaño de la muestra es n, entonces:

EE = s / √n

Esta fórmula muestra dos ideas importantes:

- Si la variabilidad de los datos es mayor, el error estándar también tiende a ser mayor.

- Si el tamaño de la muestra aumenta, el error estándar disminuye.

Por eso, trabajar con muestras más grandes suele ofrecer estimaciones más precisas que trabajar con muestras pequeñas.

Diferencia entre error estándar y desviación estándar

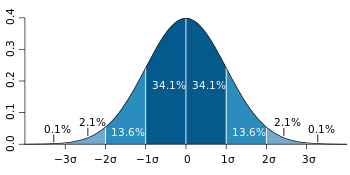

Es común confundir ambos conceptos, pero no significan lo mismo. La desviación estándar mide cuánto se dispersan los datos dentro de una muestra o población. En cambio, el error estándar mide cuánto puede variar una estadística muestral, como la media, entre distintas muestras.

En resumen:

- Desviación estándar: describe la variabilidad de los datos.

- Error estándar: describe la precisión de una estimación basada en una muestra.

Por qué en la práctica suele ser una estimación

En las mediciones reales, normalmente no se conoce el verdadero valor del error estándar de toda la población, porque no se puede estudiar cada caso posible. Por eso, el término error estándar se usa a menudo para referirse a una estimación cercana del valor real, obtenida a partir de la muestra.

Cuanto más grande y representativa sea la muestra, mejor será esa estimación. Además, si los datos son muy heterogéneos, el error estándar puede ser más alto, lo que indica mayor incertidumbre en la media u otra estadística calculada.

Interpretación básica

Un error estándar pequeño sugiere que la estadística muestral es estable y probablemente cercana al valor de la población. Un error estándar grande sugiere lo contrario: que los resultados pueden cambiar bastante de una muestra a otra.

Por ello, el error estándar es una herramienta clave para interpretar resultados en investigación, encuestas, experimentos y análisis de datos. No informa por sí solo sobre si un resultado es “bueno” o “malo”, pero sí sobre su nivel de precisión.

.jpg)