Los mínimos cuadrados ordinarios (conocidos normalmente por sus siglas OLS, del inglés Ordinary Least Squares) son un método para estimar parámetros desconocidos en estadística. Se emplean con frecuencia en la regresión lineal para ajustar una relación lineal entre una variable dependiente y una o varias variables explicativas. El objetivo de OLS es elegir los coeficientes del modelo lineal de modo que se minimice la suma de los cuadrados de las diferencias entre las observaciones reales y las predicciones del modelo; es decir, minimizar la suma de los errores al cuadrado. Cuando estas discrepancias son pequeñas, el modelo se considera que se ajusta bien a los datos. Los mínimos cuadrados ordinarios son un caso particular del método más general de mínimos cuadrados y el estimador resultante tiene expresiones analíticas sencillas en muchos casos.

Fórmula y cálculo

En notación matricial, para el modelo lineal y = Xβ + ε, donde y es el vector de observaciones, X la matriz de regresores (incluyendo normalmente una columna de unos para el intercepto), β el vector de coeficientes y ε el vector de errores, la solución OLS se expresa como:

β̂ = (X'X)⁻¹ X' y (si X'X es invertible).

En el caso simple de una regresión lineal con una sola variable explicativa x, las fórmulas de los estimadores son:

- β̂1 = ∑(xi − x̄)(yi − ȳ) / ∑(xi − x̄)² (pendiente)

- β̂0 = ȳ − β̂1 x̄ (ordenada al origen)

Los residuos se definen como ei = yi − ŷi y la suma de residuos al cuadrado (SSR) es la cantidad que OLS minimiza: SSR = ∑ ei².

Supuestos habituales (Gauss–Markov)

Para que los estimadores OLS tengan propiedades óptimas clásicas se suelen asumir, al menos, las siguientes condiciones:

- El modelo es lineal en los parámetros.

- No existe multicolinealidad perfecta entre las columnas de X.

- Esperanza condicional de los errores nula: E(ε | X) = 0 (exogeneidad).

- Homoscedasticidad: Var(εi | X) = σ² constante.

- No autocorrelación de los errores: Cov(εi, εj | X) = 0 para i ≠ j.

Bajo estos supuestos, el teorema de Gauss–Markov establece que OLS es el mejor estimador lineal insesgado (BLUE — Best Linear Unbiased Estimator).

Propiedades e inferencia

- Insesgadez: E(β̂) = β cuando E(ε|X)=0.

- Varianza: Var(β̂) = σ² (X'X)⁻¹. En la práctica se estima σ² por s² = SSR/(n − p), donde p es el número de parámetros estimados.

- Intervalos y pruebas: Con errores normalmente distribuidos (o con n grande por el teorema del límite central), las pruebas t para coeficientes y la prueba F para hipótesis conjuntas son aplicables.

- Bondad de ajuste: El coeficiente de determinación R² = 1 − SSR/SST cuantifica la proporción de la variabilidad total explicada por el modelo (SST = ∑(yi − ȳ)²).

Diagnóstico y limitaciones

Aunque OLS es sencillo y ampliamente usado, presenta limitaciones cuando se violan los supuestos:

- Heterocedasticidad: Si la varianza de los errores no es constante, las varianzas estándar de los estimadores OLS son incorrectas. Soluciones: errores estándar robustos (White), estimación por Weighted Least Squares (WLS) o Generalized Least Squares (GLS).

- Autocorrelación: Presente en series temporales; afecta a la eficiencia y a las pruebas. Diagnóstico con Durbin–Watson y soluciones con modelos autoregresivos o GLS.

- Multicolinealidad: Cuando las explicativas están altamente correlacionadas, las estimaciones de coeficientes son inestables (altas varianzas). Diagnóstico: VIF (Variance Inflation Factor). Remedios: eliminar variables redundantes, combinar variables o usar regularización (ridge, lasso).

- Outliers y observaciones influyentes: Pueden distorsionar el ajuste. Herramientas: análisis de residuos, distancia de Cook, métodos robustos de regresión.

- Especificación errónea: Omisión de variables relevantes, forma funcional incorrecta o errores en las variables explicativas producen sesgos. Es importante comprobar gráficos, transformaciones y pruebas de especificación.

Aplicaciones y pasos prácticos

OLS se utiliza en economía, ciencias sociales, ingeniería, biología y muchas otras áreas para:

- Estimar relaciones entre variables y cuantificar efectos marginales.

- Realizar predicciones puntuales y por intervalo.

- Contrastar hipótesis sobre la significancia de variables.

Pasos habituales al aplicar OLS:

- Formular el modelo y seleccionar variables.

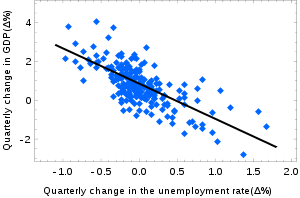

- Explorar los datos y visualizar relaciones.

- Estimar el modelo (por ejemplo, con software: R (lm), Python (statsmodels.api.OLS), o paquetes estadísticos).

- Evaluar supuestos mediante diagnósticos (residuos, pruebas de heterocedasticidad, VIF, etc.).

- Si procede, aplicar correcciones (robust SE, transformaciones, WLS, GLS o regularización).

- Interpretar coeficientes, estimar intervalos de confianza y elaborar conclusiones.

Consejos prácticos

- Siempre inspeccione gráficas de dispersión y de residuos antes de confiar plenamente en los resultados.

- No confunda correlación con causalidad: la validez causal requiere diseño o supuestos adicionales (variables instrumentales, experimentos, etc.).

- Si X'X es singular o mal condicionada, use la pseudo-inversa de Moore–Penrose o métodos de regularización.

- Documente las decisiones de modelado, las pruebas realizadas y las correcciones aplicadas para garantizar reproducibilidad.

En resumen, los mínimos cuadrados ordinarios son una herramienta fundamental y sencilla para estimar relaciones lineales. Su uso apropiado requiere entender sus supuestos, comprobar diagnósticos y, en caso necesario, aplicar métodos alternativos o correcciones para obtener estimaciones fiables.