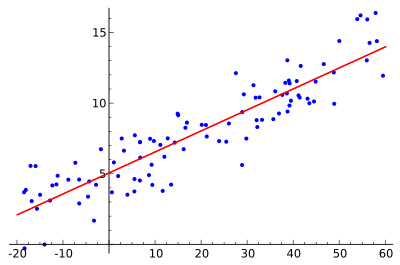

La regresión lineal es un método estadístico que describe cómo cambia una variable cuando cambian otras utilizando modelos matemáticos sencillos. Una regresión lineal relaciona una variable dependiente y una o más variables explicativas mediante una función lineal; la representación gráfica de esa relación suele ser una línea de regresión.

Históricamente, la regresión lineal fue la primera técnica desarrollada dentro de el análisis de regresión, en parte porque los modelos que dependen linealmente de sus parámetros son más sencillos de ajustar y estudiar. Además, las propiedades estadísticas de los estimadores resultantes (como sesgo, varianza y consistencia) son más fáciles de determinar en el caso lineal.

Usos principales

- Predicción: Ajustar un modelo a observaciones para predecir valores futuros o no observados. Por ejemplo, si conocemos un nuevo valor de X, el modelo puede estimar el correspondiente valor de y (escrito a menudo como

).

- Análisis de relaciones: Evaluar la fuerza y dirección de la relación entre y y un conjunto de X1, ..., Xp, identificar variables explicativas irrelevantes o redundantes y cuantificar efectos parciales.

Formulación básica y estimación (mínimos cuadrados)

En la regresión lineal simple con una sola variable explicativa, el modelo se escribe:

y = β0 + β1x + ε,

donde β0 es la ordenada al origen, β1 la pendiente (efecto marginal de x) y ε el término de error aleatorio. En el caso múltiple con p explicativas, en notación matricial:

y = Xβ + ε,

donde X es la matriz de diseño, β el vector de parámetros y ε el vector de errores.

El método más habitual para estimar β es el de mínimos cuadrados, que busca minimizar la suma de los cuadrados de los residuos (las diferencias verticales entre observaciones y la línea ajustada). El estimador de mínimos cuadrados ordinarios (OLS) tiene la forma:

β̂ = (X'X)−1 X'y,

i − xi'β)2.

Supuestos clásicos

Para que las propiedades estándar del OLS (como ser el mejor estimador lineal insesgado) se mantengan, se suelen asumir:

- Linealidad en los parámetros: el modelo es lineal en β.

- Exogeneidad: E(ε | X) = 0 (los errores no están correlacionados con las explicativas).

- No multicolinealidad perfecta: las columnas de X son linealmente independientes.

- Homoscedasticidad: Var(εi | X) = σ2 (varianza constante).

- No autocorrelación entre errores (especialmente importante en series temporales).

- Si además los errores son normales, ε ~ N(0, σ2I), se obtienen inferencias exactas (contrastes t y F).

Propiedades y pruebas

- Gauss–Markov: Bajo los supuestos de linealidad, exogeneidad, homoscedasticidad y sin multicolinealidad perfecta, el OLS es BLUE (Best Linear Unbiased Estimator), es decir, el mejor (mínima varianza) entre los estimadores lineales insesgados.

- Inferencia: Con estimaciones de varianza adecuadas se construyen intervalos de confianza para β̂, se realizan pruebas t para cada coeficiente y pruebas F para contrastes múltiples o para la significancia conjunta del modelo.

- Medidas de ajuste: El coeficiente de determinación R2 mide la proporción de la variabilidad de y explicada por el modelo; su versión ajustada corrige por el número de explicativas y el tamaño de muestra.

Diagnóstico y problemas comunes

Antes de interpretar resultados es esencial comprobar supuestos y realizar diagnósticos:

- Residuos: Gráficas de residuos vs ajustados y QQ-plots ayudan a detectar heteroscedasticidad, no linealidad o errores no normales.

- Multicolinealidad: Se detecta con el Factor de Inflación de la Varianza (VIF). Multicolinealidad alta dificulta estimar con precisión coeficientes individuales.

- Heteroscedasticidad: Pruebas como Breusch–Pagan o White y estimadores de varianza robusta (sandwich) ayudan a corregir inferencias.

- Autocorrelación: En series temporales puede usarse la prueba de Durbin–Watson y modelos que incluyan estructura temporal (AR, modelos de errores) si existe autocorrelación.

- Observaciones influyentes: Índices como Cook's distance detectan puntos que distorsionan el ajuste.

Limitaciones y alternativas

La regresión lineal tiene limitaciones cuando los supuestos no se cumplen o la relación no es lineal. Entre las alternativas y extensiones más comunes están:

- Regresión robusta: Métodos M-estimators, mínimos absolutos, o técnicas que reducen la influencia de outliers.

- Penalización y selección: Regresión de cresta (ridge), Lasso y elastic net penalizan la complejidad y ayudan con multicolinealidad y selección de variables.

- Modelos no lineales y transformaciones: Usar polinomios, splines o transformar variables cuando la relación no es lineal.

- Regresión cuantílica: Minimiza desviaciones absolutas ponderadas y estudia diferentes cuantiles de la distribución condicional de y.

Interpretación práctica

Un coeficiente β̂j en un modelo lineal múltiple se interpreta como el cambio esperado en la media de y cuando la variable Xj aumenta en una unidad, manteniendo constantes las demás variables del modelo. El intercepto β̂0 representa el valor esperado de y cuando todas las X son cero (interpretación válida solo si ese punto tiene sentido en el contexto).

Ejemplo sencillo: si se ajusta altura = β0 + β1 edad + ε y β̂1 = 2 cm/año, entonces, en promedio, cada año adicional de edad se asocia con un aumento de 2 cm en la altura, manteniendo otras condiciones.

Resumen

La regresión lineal es una herramienta fundamental para predicción y análisis de relaciones entre variables. Su simplicidad la hace muy útil, pero exige verificar supuestos y aplicar diagnósticos. Cuando los supuestos no se cumplen o existen problemas como multicolinealidad, heteroscedasticidad o outliers, conviene recurrir a variantes (robustas, penalizadas) o a modelos más flexibles. En todo caso, la interpretación cuidadosa de coeficientes, junto con medidas de ajuste e intervalos de confianza, permite extraer conclusiones útiles y cuantificables.