Una red neuronal (también llamada RNA o red neuronal artificial) es una especie de software informático, inspirado en las neuronas biológicas. Los cerebros biológicos son capaces de resolver problemas difíciles, pero cada neurona sólo es responsable de resolver una parte muy pequeña del problema. Del mismo modo, una red neuronal está formada por células que trabajan juntas para producir un resultado deseado, aunque cada célula individual sólo es responsable de resolver una pequeña parte del problema. Este es un método para crear programas artificialmente inteligentes.

Las redes neuronales son un ejemplo de aprendizaje automático, en el que un programa puede cambiar a medida que aprende a resolver un problema. Una red neuronal puede ser entrenada y mejorada con cada ejemplo, pero cuanto más grande es la red neuronal, más ejemplos necesita para funcionar bien, necesitando a menudo millones o miles de millones de ejemplos en el caso del aprendizaje profundo.

¿Cómo funcionan las redes neuronales?

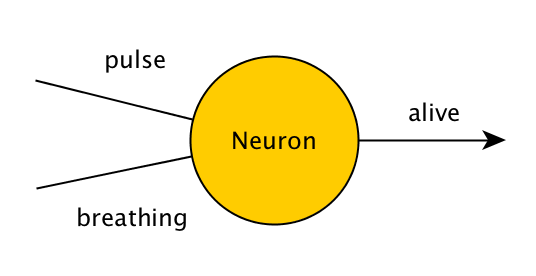

En términos sencillos, una red neuronal está compuesta por capas de unidades llamadas neuronas artificiales o nodos. Cada neurona recibe entradas, las combina mediante pesos y sesgos, aplica una función de activación y produce una salida que se transmite a las neuronas de la siguiente capa. Los elementos clave del funcionamiento son:

- Entradas: los datos iniciales (imágenes, texto, señales, etc.).

- Pesos y sesgos: parámetros que la red ajusta durante el entrenamiento. Controlan la influencia de cada entrada.

- Funciones de activación: introducen no linealidad (por ejemplo, ReLU, sigmoide, tanh) permitiendo resolver problemas complejos.

- Capas: estructura típica: capa de entrada, una o varias capas ocultas y capa de salida.

- Salida: la predicción o decisión final (clasificación, regresión, generación de texto, etc.).

Entrenamiento: aprendizaje y ajuste de parámetros

El proceso de entrenamiento ajusta los pesos y sesgos para minimizar un función de pérdida que mide el error entre la salida de la red y la respuesta correcta. Los pasos básicos son:

- Propagación hacia delante: calcular la salida para un ejemplo de entrenamiento.

- Cálculo de la pérdida: evaluar cuánto se aleja la predicción del valor deseado.

- Retropropagación (backpropagation): calcular gradientes de la pérdida respecto a los parámetros.

- Optimización: actualizar pesos usando algoritmos como SGD, Adam, RMSprop, etc.

Existen diferentes paradigmas de aprendizaje: supervisado (con etiquetas), no supervisado (descubrir estructura en datos sin etiquetas) y por refuerzo (aprendizaje mediante recompensas). Además, se usan técnicas para evitar el sobreajuste (overfitting) y mejorar la generalización: regularización, dropout, aumento de datos, validación cruzada, etc.

Tipos y arquitecturas comunes

Las redes neuronales adoptan muchas formas según la tarea:

- Perceptrón y redes feedforward: fluyen de entrada a salida sin ciclos; son la base del aprendizaje supervisado.

- Redes convolucionales (CNN): diseñadas para procesar datos con estructura espacial (imágenes, vídeo); usan filtros que detectan patrones locales.

- Redes recurrentes (RNN) y variantes (LSTM, GRU): adecuadas para datos secuenciales como texto y señales temporales.

- Transformers: basados en mecanismos de atención; hoy dominan tareas de procesamiento de lenguaje natural y generación de secuencias.

- Autoencoders y redes generativas: para reducción de dimensionalidad, compresión y generación de datos (ej.: GANs, VAEs).

Aplicaciones prácticas

Las redes neuronales se emplean en numerosos campos, por ejemplo:

- Visión por computador: reconocimiento de objetos, segmentación, diagnóstico por imagen en medicina.

- Procesamiento del lenguaje natural (NLP): traducción automática, clasificación de texto, asistentes conversacionales y modelos de lenguaje.

- Reconocimiento de voz y síntesis: conversión voz-texto y generación de voz natural.

- Robótica y control: navegación autónoma, manipulación y aprendizaje de políticas.

- Finanzas y comercio: detección de fraude, predicción de mercados, análisis de clientes.

- Ciencias de la salud: descubrimiento de fármacos, modelos predictivos de enfermedades, análisis genómicos.

Ventajas y limitaciones

Las redes neuronales ofrecen:

- Gran capacidad: pueden aproximar funciones muy complejas y aprender representaciones útiles automáticamente.

- Flexibilidad: adaptables a multitud de tipos de datos y tareas.

Sin embargo, presentan retos:

- Necesidad de datos: las redes grandes requieren grandes volúmenes de datos etiquetados y cómputo intensivo.

- Interpretabilidad limitada: suelen ser cajas negras; explicar por qué toman una decisión puede ser difícil.

- Sesgos y seguridad: si los datos contienen sesgos, la red los aprende; además son vulnerables a ataques adversarios.

- Coste energético y ambiental: entrenar modelos muy grandes consume mucha energía y recursos.

Buenas prácticas y consideraciones

- Reunir y limpiar datos representativos para evitar sesgos.

- Usar conjuntos de validación y pruebas separadas para medir generalización.

- Aplicar regularización y técnicas de calibrado para reducir sobreajuste.

- Evaluar el impacto ético y social antes de desplegar modelos en entornos sensibles.

- Monitorizar el rendimiento en producción y actualizar el modelo según cambien los datos.

Perspectivas futuras

La investigación sigue avanzando en hacer las redes más eficientes, explicables y seguras. Áreas activas incluyen arquitecturas más compactas, aprendizaje con menos datos (few-shot y self-supervised), mejores métodos de interpretación y normas para un uso responsable de la IA.

En resumen, las redes neuronales son una herramienta fundamental del artificialmente inteligentes moderno: potentes y versátiles, pero requieren datos, recursos y consideraciones éticas para su uso efectivo y seguro.