La biología del aprendizaje por refuerzo se puede encontrar en Condicionamiento operante y Recompensa

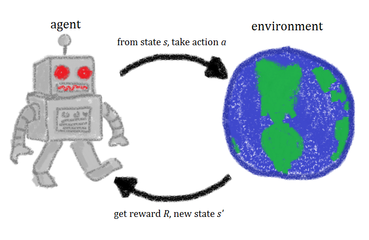

El aprendizaje por refuerzo (RL) consiste en enseñar a un agente informático a comportarse en un entorno diciéndole lo bien que lo hace. Es un área del aprendizaje automático inspirada en la psicología conductista.

El aprendizaje por refuerzo es diferente del aprendizaje supervisado porque nunca se muestran las entradas y salidas correctas. Además, el aprendizaje por refuerzo suele aprender sobre la marcha (aprendizaje en línea), a diferencia del aprendizaje supervisado. Esto significa que un agente tiene que elegir entre explorar o quedarse con lo que mejor conoce.

Principios clave

- Interacción agente–entorno: el agente observa el estado del entorno, toma una acción y recibe a cambio una recompensa y un nuevo estado.

- Objetivo: maximizar la recompensa acumulada a largo plazo, no solo la inmediata.

- Exploración vs. explotación: equilibrio entre probar acciones nuevas para aprender (exploración) y usar las mejores acciones conocidas para obtener recompensa (explotación).

- Aprendizaje por prueba y error: políticas y valores se ajustan en función del feedback diferido que proporciona la recompensa.

Componentes fundamentales

- Estado (S): descripción de la situación actual del entorno.

- Acción (A): decisiones que puede tomar el agente.

- Recompensa (R): señal escalar que el entorno devuelve tras una acción.

- Política (π): estrategia del agente para escoger acciones según estados.

- Función de valor: estima la recompensa esperada futura desde un estado o desde un par estado‑acción (por ejemplo, V(s) o Q(s,a)).

- Modelo (opcional): predicción de la dinámica del entorno (cómo cambian estados y recompensas tras acciones). Los métodos que usan este modelo se llaman model-based; los que no, model-free.

- Marco formal: muchas formulaciones usan el proceso de decisión de Markov (MDP), definido por la tupla (S, A, P, R, γ), donde P son las probabilidades de transición y γ es el factor de descuento para valorar recompensas futuras.

Algoritmos y familias principales

- Model-free: aprenden directamente políticas o funciones de valor sin modelar el entorno. Ejemplos clásicos:

- Q‑learning (valores de acción Q).

- SARSA (on‑policy).

- Temporal Difference (TD) y TD(λ).

- Policy gradient: optimizan directamente la política mediante gradientes (útiles para espacios de acción continuos).

- Actor‑Critic: combinan una política (actor) y una estimación de valor (critic).

- Model-based: aprenden o usan un modelo del entorno para planificar (ej.: Dyna, métodos basados en búsqueda).

- Aprendizaje profundo por refuerzo (Deep RL): utiliza redes neuronales para aproximar políticas o funciones de valor (ej.: DQN, PPO, A3C/A2C, SAC).

Diferencias clave con otros tipos de aprendizaje

- Con aprendizaje supervisado: en supervisado hay pares entrada‑salida correctos; en RL no se indican acciones correctas, solo recompensas. RL suele requerir exploración y manejar recompensas retrasadas.

- Con aprendizaje no supervisado: éste busca estructuras en datos sin etiquetas; RL busca maximizar una señal de recompensa mediante interacción.

- Aprendizaje en línea vs. por lotes: RL tradicionalmente aprende en línea (datos generados por el agente); existen también métodos de RL offline/batch que aprenden a partir de datos grabados.

Retos y consideraciones prácticas

- Eficiencia en muestras: muchas técnicas de RL requieren grandes cantidades de interacciones, lo que es costoso en aplicaciones reales (robotics, producción).

- Recompensas escasas o mal definidas: diseñar una función de recompensa adecuada (shaping) es crítico y puede inducir comportamientos no deseados.

- Asignación de crédito: determinar qué acciones pasadas fueron responsables de resultados futuros es complejo.

- Seguridad y robustez: garantizar comportamiento seguro ante distribuciónes nuevas o adversas.

- Observabilidad parcial: cuando el agente no ve todo el estado se requieren modelos como POMDP o memorias/recurrencias.

Aplicaciones típicas

- Juegos y simulaciones (ajedrez, Go, videojuegos).

- Robótica y control continuo (manipulación, navegación).

- Sistemas de recomendación y anuncios (optimizar métricas a largo plazo).

- Optimización de recursos y logística (gestión de inventarios, tráfico).

- Finanzas y trading algorítmico (decisiones secuenciales bajo incertidumbre).

Resumen

El aprendizaje por refuerzo es una rama del aprendizaje automático centrada en la toma de decisiones secuenciales mediante la maximización de recompensas acumuladas. Combina ideas de teoría de decisiones, psicología conductista y aprendizaje estadístico. Sus puntos distintivos frente a otros paradigmas son la ausencia de respuestas correctas explícitas, la necesidad de explorar el entorno y la gestión de recompensas retrasadas. A pesar de sus retos (eficiencia de datos, diseño de recompensas, seguridad), el RL ha demostrado ser muy potente en tareas donde la interacción y la optimización a largo plazo son fundamentales.