Un algoritmo es un procedimiento paso a paso para resolver problemas lógicos y matemáticos. Se trata de una descripción finita y precisa de operaciones que, aplicadas correctamente, transforman una o varias entradas en una o varias salidas.

Origen del término

Las palabras "algoritmo" y "algorismo" provienen del nombre de un matemático persa llamado Al-Khwārizmī (persa: خوارزمی, c. 780-850). Su obra sobre aritmética y métodos de cálculo fue difundida en la Europa medieval y, por adaptación del nombre, surgieron los términos que hoy usamos para referirnos a procedimientos de cálculo.

Ejemplos sencillos

Una receta es un buen ejemplo de algoritmo porque dice lo que hay que hacer, paso a paso. Toma entradas (ingredientes) y produce una salida (el plato terminado).

Otros ejemplos cotidianos incluyen:

- Las instrucciones para montar un mueble: pasos ordenados para obtener el producto final.

- Un diagrama de instrucciones para reparar una máquina o seguir una rutina de mantenimiento.

- Algoritmos matemáticos clásicos, como el algoritmo de Euclides para calcular el máximo común divisor (MCD) de dos números.

Características formales de un algoritmo

Para que una descripción sea considerada un algoritmo suelen exigirse estas propiedades básicas:

- Finitud: debe terminar tras un número finito de pasos.

- Definición: cada paso está claramente definido y no deja lugar a ambigüedad.

- Entradas: puede aceptar cero o más datos de entrada.

- Salidas: produce al menos un resultado o efecto observable.

- Efectividad: cada operación debe ser realizable en un tiempo razonable por una persona o máquina.

Algoritmos en informática

Informalmente, un algoritmo puede llamarse "lista de pasos". Los algoritmos pueden escribirse en lenguaje ordinario, y eso puede ser todo lo que una persona necesita. En informática, un algoritmo es una lista precisa de operaciones que podría realizar una máquina de Turing. En informática, los algoritmos se escriben en pseudocódigo, diagramas de flujo o lenguajes de programación.

Además, existen distintos tipos de algoritmos según su naturaleza y propósito: deterministas, no deterministas, aleatorios (randomizados), voraces (greedy), de división y conquista, dinámicos, aproximados y heurísticos, entre otros.

Representación y ejemplos en informática

Maneras comunes de representar y comunicar algoritmos:

- Pseudocódigo: lenguaje informal que facilita expresar la lógica sin detalles sintácticos de un lenguaje real.

- Diagramas de flujo: representan visualmente la secuencia y las decisiones.

- Implementación en un lenguaje de programación para ejecutarlo en una computadora.

Ejemplos típicos de algoritmos informáticos:

- Búsqueda: búsqueda binaria en una lista ordenada.

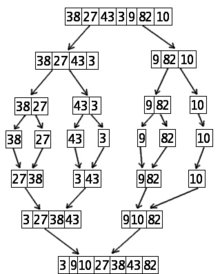

- Ordenación: quicksort, mergesort, heapsort, bubblesort (como ejemplo educativo).

- Grafos: Dijkstra para caminos mínimos, algoritmo de Kruskal o Prim para árboles de expansión mínima.

- Criptografía: algoritmos para cifrado, firma y verificación.

Medición: complejidad y corrección

Al diseñar y elegir algoritmos se valoran dos aspectos fundamentales:

- Corrección: el algoritmo produce la salida correcta para todas las entradas válidas. La corrección suele demostrarse mediante argumentos formales o pruebas matemáticas.

- Complejidad: mide los recursos necesarios, habitualmente tiempo (número de pasos) y espacio (memoria). La notación Big O se usa para describir el comportamiento asintótico del tiempo o espacio en función del tamaño de la entrada.

Aplicaciones prácticas

Los algoritmos están en el corazón de la informática y se aplican en casi todos los ámbitos tecnológicos:

- Búsqueda y recuperación de información (motores de búsqueda).

- Procesamiento de imágenes y señales.

- Aprendizaje automático y minería de datos.

- Optimización y logística (rutas, programación de tareas).

- Seguridad informática (cifrado, detección de intrusiones).

- Sistemas operativos, bases de datos y redes.

Conclusión

Un algoritmo es mucho más que una receta: es la formalización de un procedimiento que permite automatizar tareas, razonar sobre soluciones y medir su eficiencia. Desde los métodos de cálculo difundidos por Al-Khwārizmī hasta los algoritmos que hacen posible la inteligencia artificial actual, su estudio y diseño siguen siendo uno de los pilares de la informática y las matemáticas aplicadas.