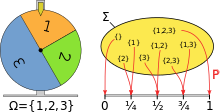

El espacio de probabilidad es un modelo matemático utilizado para describir experimentos científicos. Un espacio de probabilidad consta de tres partes fundamentales:

- Un espacio muestral que recoge todos los resultados posibles

- Un conjunto de eventos. Cada evento asocia cero o más resultados

- Una función que asigna probabilidades a cada evento

Definición formal

Formalmente, un espacio de probabilidad se expresa como el triplete (Ω, F

- Ω (omega) es el espacio muestral, el conjunto de todos los posibles resultados (o resultados elementales), y un elemento individual de Ω se denota por ω.

- F

es una σ-álgebra de subconjuntos de Ω (la colección de eventos), es decir, un conjunto de subconjuntos de Ω cerrado bajo complementos y uniones contables.

- P es la medida de probabilidad, una función P: F → [0,1] que asigna a cada evento A ∈ F un número P(A) interpretado como su probabilidad.

Axiomas de Kolmogorov

Los axiomas que debe satisfacer la función P fueron formalizados por Andrey Kolmogorov (Grundbegriffe, 1933). Enunciados de forma habitual:

- No negatividad: Para todo A ∈ F, P(A) ≥ 0.

- Normalización: P(Ω) = 1.

- Aditividad contable: Si {A1, A2, A3, ...} es una colección numerable de eventos mutuamente disjuntos (Ai ∩ Aj = ∅ para i ≠ j), entonces P(⋃i Ai) = Σi P(Ai).

Propiedades derivadas

De los axiomas se deducen propiedades útiles:

- P(∅) = 0 (la probabilidad del evento imposible es cero).

- Monotonía: Si A ⊆ B entonces P(A) ≤ P(B).

- Complemento: P(A^c) = 1 − P(A).

- Fórmula de la unión: P(A ∪ B) = P(A) + P(B) − P(A ∩ B).

- Continuidad desde abajo y desde arriba: para sucesiones crecientes o decrecientes de eventos existen límites de probabilidades que coinciden con la probabilidad del límite del conjunto.

Sobre la σ-álgebra y la medición

La σ-álgebra F asegura que las operaciones relevantes con eventos (complemento, uniones e intersecciones contables) produzcan de nuevo eventos a los que se pueda asignar una probabilidad. En situaciones sencillas (por ejemplo, experimentos con un número finito de resultados) se puede tomar F como el conjunto de todas las partes de Ω. En casos continuos, como variables reales, se emplea con frecuencia la σ-álgebra de Borel sobre R y se miden los eventos mediante la medida asociada (p. ej., la medida de Lebesgue combinada con una densidad).

Interpretación

Se suele explicar el funcionamiento del espacio de probabilidad mediante la idea de que la "naturaleza" selecciona un único resultado ω ∈ Ω cuando se realiza el experimento. Se dice que "ocurren" todos los sucesos de F

Ejemplos prácticos

- Lanzamiento de una moneda justa: Ω = {cara, cruz}, F = P(Ω) = {∅,{cara},{cruz},Ω}, P({cara}) = P({cruz}) = 1/2.

- Tirada de un dado justo: Ω = {1,2,3,4,5,6}, con probabilidades iguales 1/6 para cada resultado elemental y eventos como "obtener un número par".

- Distribuciones continuas: Para una variable aleatoria con densidad f en R, P(a ≤ X ≤ b) = ∫_a^b f(x) dx; aquí la medida subyacente es la medida de Lebesgue y F típicamente contiene los conjuntos borelianos.

Probabilidad condicional e independencia

La probabilidad condicional de A dado B (cuando P(B) > 0) se define por

P(A | B) = P(A ∩ B) / P(B).

Dos eventos A y B son independientes si P(A ∩ B) = P(A) P(B). Esta noción generaliza a colecciones mayores de eventos y es central en estadística y teoría de la información.

Extensiones y aplicaciones

La noción de espacio de probabilidad es la base para conceptos posteriores como variables aleatorias (funciones medibles X: Ω → R), esperanza matemática, varianza, procesos estocásticos (por ejemplo, cadenas de Markov, movimientos brownianos) y teoría de la inferencia estadística. Gracias a la formulación de Kolmogorov, estas herramientas se apoyan en un marco común y riguroso que conecta la teoría de la medida con la probabilidad.

El destacado matemático soviético Andrey Kolmogorov consolidó esta noción en la década de 1930 (obra clásica: Grundbegriffe, 1933), aportando los axiomas que actualmente sirven de fundamento a la teoría moderna de la probabilidad.