En estadística y teoría de la probabilidad, la correlación se refiere a la relación o dependencia entre dos conjuntos de datos. Más precisamente, mide hasta qué punto los valores de una variable tienden a cambiar cuando cambian los de otra.

Es importante subrayar que la correlación no implica necesariamente causalidad. Dos variables pueden correlacionar porque una causa a la otra, porque una es efecto de la otra, porque existe una relación bidireccional o porque hay un tercer factor (confusor) que influye en ambas. También puede tratarse de una correlación espuria por coincidencia o por errores en la medición.

Direcciones e interpretación

La correlación suele describirse por su dirección y su magnitud:

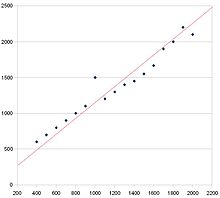

- Correlación positiva: cuando los valores de ambas variables tienden a aumentar juntos. En un gráfico de dispersión los puntos forman una nube con pendiente ascendente.

- Correlación negativa: cuando una variable tiende a aumentar mientras la otra disminuye; la nube de puntos tiene pendiente descendente.

- Sin correlación lineal: si no hay una relación lineal evidente; puede existir otra relación (por ejemplo, cuadrática) que una medida lineal no detecte.

La dirección no indica causalidad. Además de la dirección, se valora la fuerza de la correlación (qué tan clara o estrecha es la relación).

Medidas comunes de correlación

- Coeficiente de correlación de Pearson (r): mide la asociación lineal entre dos variables cuantitativas. Varía entre -1 y 1. Valores cercanos a ±1 indican una relación lineal fuerte; 0 indica ausencia de correlación lineal. Requiere ciertas condiciones (linealidad, homocedasticidad y, para inferencia, normalidad de los residuos).

- Coeficiente de determinación (r²): indica la proporción de varianza de una variable explicada por la otra en un modelo lineal simple (por ejemplo, r = 0.7 → r² = 0.49, es decir 49% de la varianza explicada).

- Coeficiente de correlación de Spearman (rho): mide la relación monótona usando rangos; es robusto frente a valores atípicos y útil para relaciones no estrictamente lineales.

- Kendall (tau): otra medida de correlación de rangos, especialmente útil con muestras pequeñas o muchas empates.

- Coeficientes para variables categóricas: phi, V de Cramer o correlación punto-biserial para medidas mixtas.

- Otras medidas: correlación parcial (controlando otras variables), correlaciones robustas y medidas modernas como correlación de distancia, que detecta asociaciones no lineales.

Representación gráfica

El gráfico de dispersión es la herramienta básica para explorar correlaciones entre variables numéricas: permite ver la dirección, forma (lineal o no), fuerza y la presencia de outliers que pueden distorsionar medidas como Pearson. A menudo se superpone una línea de mejor ajuste (regresión lineal) para visualizar la tendencia promedio.

Significancia estadística y muestreo

Cuando se calcula una correlación en una muestra, se suele realizar una prueba de hipótesis para determinar si la correlación observada difiere significativamente de cero en la población. El valor p y los intervalos de confianza ayudan a evaluar la incertidumbre. El tamaño de la muestra influye mucho en la capacidad para detectar correlaciones pequeñas: con muestras grandes, correlaciones pequeñas pueden resultar estadísticamente significativas aunque no sean relevantes desde el punto de vista práctico.

Limitaciones y precauciones

- Correlación ≠ causalidad: siempre considerar la posibilidad de confusores, direccionalidad inversa o variables omitidas.

- Relaciones no lineales: una correlación de Pearson cercana a cero no implica ausencia de relación; puede existir una relación no lineal que dicha medida no capture.

- Outliers: valores atípicos pueden inflar o reducir la correlación; conviene inspeccionar y, si procede, usar medidas robustas o transformar los datos.

- Sesgo por muestreo o medición: errores sistemáticos en la recogida de datos pueden generar correlaciones engañosas.

- Simpson: la paradoja de Simpson muestra cómo relaciones observadas en subgrupos pueden invertirse en el conjunto agregado.

- Correlaciones espurias: coincidencias estadísticas o series temporales con tendencias comunes pueden producir correlaciones sin relación causal real.

Consejos prácticos

- Antes de calcular coeficientes, visualiza los datos con un gráfico de dispersión.

- Comprueba supuestos (linealidad, homocedasticidad) si vas a usar Pearson; si no se cumplen, considera Spearman o transformaciones.

- Investiga posibles confusores y calcula correlaciones parciales si es necesario.

- Reporta no solo el coeficiente, sino también el intervalo de confianza y el tamaño de la muestra.

- No bases conclusiones causales únicamente en correlaciones; para causalidad usa diseños experimentales o métodos de inferencia causal (variables instrumentales, experimentos aleatorizados, análisis longitudinal).

En resumen, la correlación es una herramienta poderosa para explorar relaciones entre variables, pero su interpretación requiere cuidado: distinguir dirección, magnitud y forma de la asociación, controlar supuestos y considerar alternativas explicativas antes de sacar conclusiones causales.