Canalización de instrucciones (pipelining): qué es y cómo funciona

Aprende la canalización de instrucciones (pipelining): qué es, cómo acelera CPUs, sus etapas (fetch, decode, execute...) y por qué mejora el rendimiento en microprocesadores modernos.

El pipelining de instrucciones es una técnica utilizada en el diseño de microprocesadores, microcontroladores y CPUs modernos para aumentar su rendimiento de instrucciones (el número de instrucciones que pueden ejecutarse en una unidad de tiempo). Al introducir paralelismo a nivel de etapas de ejecución, el procesador puede procesar varias instrucciones en distintos estadios del ciclo de instrucción de forma concurrente.

Cómo funciona (concepto básico)

La idea principal es dividir (lo que se denomina "split") el procesamiento de una instrucción de la CPU, tal y como se define en el microcódigo de la instrucción, en una serie de pasos independientes de microoperaciones (también llamados "microinstrucciones", "micro-op" o "µop"), con almacenamiento al final de cada paso. Esto permite a la lógica de control de la CPU manejar las instrucciones a la velocidad del paso más lento, que suele ser mucho más rápida que el tiempo necesario para procesar la instrucción como un único bloque.

El término tubería o pipeline viene de la analogía con una tubería: cada etapa contiene una sola porción de trabajo (como una gota de agua) y pasa su resultado a la etapa siguiente. Los límites entre etapas se implementan con registros interstadio —normalmente flip flops— que almacenan temporalmente los datos y permiten que cada etapa trabaje de forma semi-independiente.

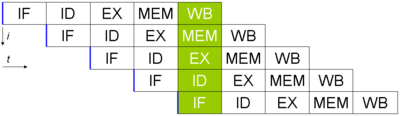

Ejemplo típico: pipeline RISC de 5 etapas

Por ejemplo, muchos diseños RISC dividen el trabajo en cinco etapas con un conjunto de flip flops entre cada una:

- Búsqueda de instrucciones

- Descodificación de instrucciones y obtención de registros

- Ejecutar

- Acceso a la memoria

- Registrar la respuesta

Descripción breve de cada etapa:

- Búsqueda de instrucciones: la CPU lee la instrucción desde la memoria o caché de instrucciones usando el contador de programa.

- Descodificación y obtención de registros: la instrucción se decodifica, se identifican operandos y se leen los registros fuente del banco de registros.

- Ejecutar: la unidad aritmético-lógica (ALU) u otras unidades funcionales realizan la operación (suma, comparación, cálculo de dirección, etc.).

- Acceso a memoria: si la instrucción requiere leer o escribir memoria (por ejemplo, cargas/almacenamientos), se accede a la memoria o caché.

- Registrar la respuesta: el resultado se escribe en el registro de destino o se actualizan los flags/estados necesarios.

Relación con el reloj y registros interetapas

La mayoría de las CPUs modernas trabajan síncronamente con una señal de reloj. Internamente constan de lógica combinacional y memoria (por ejemplo, flip flops). Cuando llega un pulso de reloj, los flip flops capturan valores y la lógica combinacional entre registros necesita un cierto tiempo para producir salidas válidas. Al dividir la lógica en bloques más pequeños e insertar flip flops entre esos bloques, se reduce el tiempo crítico por bloque y, por tanto, se puede aumentar la frecuencia de reloj (reducir el periodo de reloj). Esto es la esencia del pipelining: más instrucciones por unidad de tiempo a costa de mayor latencia por instrucción en algunos casos.

Rendimiento: latencia vs. throughput

El pipelining mejora el throughput (instrucciones completadas por unidad de tiempo), porque idealmente una nueva instrucción entra al pipeline en cada ciclo de reloj. Sin embargo, la latencia de una instrucción individual (tiempo desde que entra hasta que termina) puede aumentar ligeramente por el registro interetapas. Se considera que un pipeline está totalmente canalizado si puede aceptar una nueva instrucción cada ciclo de reloj. Un pipeline que no está totalmente alineado tiene ciclos de espera que retrasan el progreso del pipeline y reducen el rendimiento.

Problemas comunes (hazards) y cómo se resuelven

La canalización introduce conflictos conocidos como hazards, que impiden que cada etapa procese datos útiles en cada ciclo. Los tipos principales son:

- Hazards de datos: cuando una instrucción necesita el resultado de una instrucción anterior que aún no ha escrito su resultado. Soluciones: reenvío (forwarding), interbloqueo (stalls) y reordenación (out-of-order execution).

- Hazards estructurales: cuando dos etapas requieren el mismo recurso hardware (por ejemplo, una sola unidad de memoria para instrucciones y datos). Soluciones: duplicar recursos, arbitraje o insertar esperas.

- Hazards de control: causados por bifurcaciones (branches) y saltos, que cambian el contador de programa y hacen incierto qué instrucciones siguiente traer. Soluciones: predicción de bifurcaciones (branch prediction), ejecución especulativa y flushing del pipeline si la predicción falla.

Otros mecanismos de mitigación avanzados incluyen la ejecución fuera de orden (out-of-order execution) para explotar paralelismo dinámico y la reordenación de instrucciones por el compilador.

Ejemplos de técnicas prácticas

- Forwarding/Bypassing: reenviar el resultado de una etapa posterior directamente a una etapa anterior que lo necesita, evitando esperas innecesarias.

- Interlocks (stalls): detectar dependencias y pausar etapas anteriores hasta que el dato esté disponible (introducción de "burbuja" o bubble en el pipeline).

- Predicción de bifurcación: hardware que intenta adivinar la dirección de una branch para mantener el pipeline lleno; si la predicción es incorrecta se hace un flush y se rellena con las instrucciones correctas.

- Superescalar y multiciclos: aumentar el número de unidades funcionales para ejecutar múltiples instrucciones por ciclo (superscalar) o usar pipelines más profundos (superpipelining) para frecuencias más altas.

Ventajas y desventajas

Ventajas:

- Aumento significativo del rendimiento (mayor throughput).

- Mejor utilización de unidades funcionales: mientras unas etapas procesan una instrucción, otras etapas procesan otras.

- Permite elevar la frecuencia de reloj dividiendo la lógica en bloques más pequeños.

Desventajas:

- Complejidad de diseño mayor: control de hazards, predicción de bifurcaciones y manejo de excepciones son más complicados.

- Penalizaciones por pérdidas de predicción o dependencias: los flushes y stalls reducen el rendimiento real.

- Mayor consumo de energía y área por registros interetapas y lógica adicional.

Consideraciones finales y métricas

El beneficio teórico del pipelining ideal es aproximar un aumento de velocidad cercano al número de etapas (p. ej., un pipeline de 5 etapas puede acercarse a 5× throughput respecto a un diseño no canalizado), pero la ganancia real depende de la frecuencia de hazards, la eficiencia de la predicción de bifurcaciones y otras optimizaciones. Métricas habituales:

- CPI (Cycles Per Instruction): en un pipeline totalmente ideal CPI ≈ 1; los stalls incrementan este valor.

- Latencia por instrucción: número total de ciclos desde entrada a salida de una instrucción (aumento por pipelines más profundos y por flushes).

En resumen, la canalización de instrucciones es una técnica fundamental para mejorar el rendimiento de CPUs modernos, pero requiere mecanismos adicionales (predicción, forwarding, interlocks, etc.) para resolver los conflictos introducidos por el paralelismo entre etapas. Una arquitectura sin canalización no aprovecha tan bien el paralelismo temporal y suele tener menor throughput, aunque su diseño sea más simple y menos costoso en lógica de control, mientras que una arquitectura canalizada busca maximizar el número de instrucciones completadas por unidad de tiempo.

Canalización básica de cinco etapas en una máquina RISC (IF = búsqueda de instrucciones, ID = decodificación de instrucciones, EX = ejecución, MEM = acceso a la memoria, WB = escritura en el registro). El eje vertical son las instrucciones sucesivas, el eje horizontal es el tiempo. Así, en la columna verde, la primera instrucción se encuentra en la fase WB y la última está en fase de búsqueda de instrucciones.

Ventajas y desventajas del pipelining

Ventajas del pipelining:

- El tiempo de ciclo del procesador se reduce, aumentando el rendimiento de las instrucciones. La canalización no reduce el tiempo que se tarda en completar una instrucción, sino que aumenta el número de instrucciones que se pueden procesar simultáneamente ("a la vez") y reduce el retardo entre las instrucciones completadas (lo que se denomina "rendimiento").

Cuantas más etapas de pipeline tenga un procesador, más instrucciones podrá procesar "a la vez" y menos retraso habrá entre las instrucciones completadas. Todos los microprocesadores de

propósito general que se fabrican hoy en día utilizan al menos 2 etapas de pipeline hasta 30 o 40 etapas. - Si se utiliza el pipelining, la unidad aritmética lógica de la CPU puede diseñarse más rápidamente, pero será más compleja.

- En teoría, la canalización aumenta el rendimiento con respecto a un núcleo sin canalizar en un factor del número de etapas (suponiendo que la frecuencia de reloj también aumenta en el mismo factor) y el código es ideal para la ejecución en canal.

- Las CPUs con pipelines suelen trabajar a una frecuencia de reloj más alta que la de la RAM, (a partir de las tecnologías de 2008, las RAMs trabajan a frecuencias bajas en comparación con las frecuencias de las CPUs) aumentando el rendimiento general de los ordenadores.

Desventajas del pipelining:

El pipelining tiene muchas desventajas, aunque los diseñadores de CPUs y compiladores utilizan muchas técnicas para superar la mayoría de ellas; la siguiente es una lista de los inconvenientes más comunes:

- El diseño de un procesador no pipelinado es más sencillo y barato de fabricar, el procesador no pipelinado ejecuta una sola instrucción a la vez. Esto evita los retrasos en las bifurcaciones (en el pipelining, cada bifurcación se retrasa), así como los problemas cuando se ejecutan simultáneamente instrucciones en serie.

- En un procesador con pipelines, la inserción de flip flops entre módulos aumenta la latencia de las instrucciones en comparación con un procesador sin pipelines.

- Un procesador no canalizado tendrá un rendimiento de instrucciones definido. El rendimiento de un procesador con pipelines es mucho más difícil de predecir y puede variar mucho para diferentes programas.

- Muchos diseños incluyen pipelines de hasta 7, 10, 20, 31 e incluso más etapas; una desventaja de un pipeline largo es que cuando un programa se bifurca, todo el pipeline debe ser vaciado (limpiado). El mayor rendimiento de los pipelines se queda corto cuando el código ejecutado contiene muchas bifurcaciones: el procesador no puede saber de antemano dónde leer la siguiente instrucción, y debe esperar a que la instrucción de bifurcación termine, dejando el pipeline detrás de él vacío. Esta desventaja puede reducirse prediciendo si la instrucción de bifurcación condicional se bifurcará basándose en la actividad anterior. Una vez resuelta la bifurcación, la siguiente instrucción tiene que recorrer toda la tubería antes de que su resultado esté disponible y el procesador vuelva a "trabajar". En estos casos extremos, el rendimiento de un procesador canalizado puede ser peor que el de un procesador no canalizado.

- Por desgracia, no todas las instrucciones son independientes. En un pipeline sencillo, completar una instrucción puede requerir 5 etapas. Para funcionar a pleno rendimiento, este pipeline tendrá que ejecutar 4 instrucciones independientes posteriores mientras se completa la primera. Cualquiera de esas 4 instrucciones puede depender de la salida de la primera instrucción, lo que hace que la lógica de control del pipeline tenga que esperar e insertar un bloqueo o un ciclo de reloj desperdiciado en el pipeline hasta que se resuelva la dependencia. Afortunadamente, técnicas como el forwarding pueden reducir significativamente los casos en los que es necesario el stalling.

- Los programas que se modifican a sí mismos pueden no ejecutarse correctamente en una arquitectura de canalización cuando las instrucciones que se modifican están cerca de las instrucciones que se ejecutan. Esto puede deberse a que las instrucciones pueden estar ya en la cola de entrada de prefetch, por lo que la modificación puede no tener efecto para la próxima ejecución de instrucciones. Las cachés de instrucciones empeoran aún más el problema.

- Peligros: Cuando un programador (o compilador) escribe código ensamblador, generalmente asume que cada instrucción se ejecuta antes de la siguiente. Cuando esta suposición no es validada por el pipelining hace que un programa se comporte de forma incorrecta, la situación se conoce como peligro. Existen

varias técnicas para resolver los peligros o trabajar en torno a ellos, como el forwarding y el delaying (insertando un stall o un ciclo de reloj desperdiciado).

Ejemplos

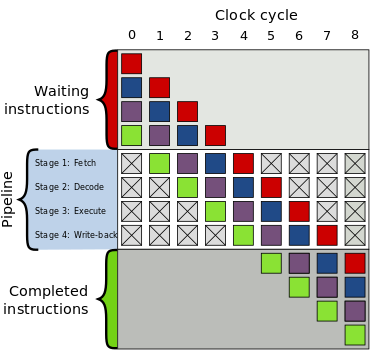

Tubería genérica

A la derecha se muestra una tubería genérica con cuatro etapas:

- Buscar en

- Descodificar

- Ejecutar

- Reescritura

El cuadro gris superior es la lista de instrucciones que esperan ser ejecutadas; el cuadro gris inferior es la lista de instrucciones que han sido completadas; y el cuadro blanco del medio es el pipeline.

La ejecución es la siguiente:

| Tiempo | Ejecución |

| 0 | Cuatro instrucciones están a la espera de ser ejecutadas |

| 1 |

|

| 2 |

|

| 3 |

|

| 4 |

|

| 5 |

|

| 6 |

|

| 7 |

|

| 8 |

|

| 9 | Todas las instrucciones se ejecutan |

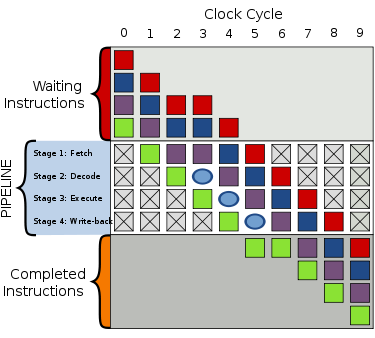

Burbuja

Cuando se produce un "hipo" (interrupción) en la ejecución, se crea una "burbuja" en el pipeline en la que no ocurre nada útil. En el ciclo 2, la búsqueda de la instrucción púrpura se retrasa y la etapa de decodificación en el ciclo 3 contiene ahora una burbuja. Todo lo que está detrás de la instrucción púrpura se retrasa también, pero todo lo que está delante de la instrucción púrpura continúa con la ejecución.

Claramente, cuando se compara con la ejecución anterior, la burbuja produce un tiempo de ejecución total de 8 ticks de reloj en lugar de 7.

Las burbujas son como los stalls (retrasos), en los que no ocurrirá nada útil para la obtención, decodificación, ejecución y escritura. Es como un código NOP (abreviatura de No OPeration).

Ejemplo 1

Una instrucción típica para sumar dos números podría ser ADD A, B, C, que suma los valores que se encuentran en las ubicaciones de memoria A y B, y luego pone el resultado en la ubicación de memoria C. En un procesador canalizado, el controlador de canalización dividiría esto en una serie de tareas similares a:

Las posiciones 'R1' y 'R2' son registros en la CPU. Los valores almacenados en las ubicaciones de memoria etiquetadas como 'A' y 'B' se cargan (copian) en estos registros, luego se suman y el resultado se almacena en una ubicación de memoria etiquetada como 'C'.

En este ejemplo, el pipeline consta de tres etapas: cargar, ejecutar y almacenar. Cada uno de los pasos se llama etapas del pipeline.

En un procesador sin canalización, sólo puede funcionar una etapa a la vez, por lo que la instrucción completa tiene que terminar antes de que pueda comenzar la siguiente. En un procesador con pipelines, todas las etapas pueden trabajar a la vez en diferentes instrucciones. Así, cuando esta instrucción está en la etapa de ejecución, una segunda instrucción estará en la etapa de decodificación y una tercera instrucción estará en la etapa de búsqueda.

Ejemplo 2

Para entender mejor el concepto, podemos ver una tubería teórica de tres etapas:

| Escenario | Descripción |

| Carga | Instrucción de lectura de la memoria |

| Ejecutar | Ejecutar instrucción |

| Tienda | Almacenar el resultado en la memoria y/o en los registros |

y un listado de pseudocódigo ensamblador para ser ejecutado:

Así es como se ejecutaría:

| Reloj 1 | ||

| Carga | Ejecutar | Tienda |

| CARGA |

|

|

La instrucción LOAD se obtiene de la memoria.

| Reloj 2 | ||

| Carga | Ejecutar | Tienda |

| MOVER | CARGA |

|

La instrucción LOAD se ejecuta, mientras que la instrucción MOVE se obtiene de la memoria.

| Reloj 3 | ||

| Carga | Ejecutar | Tienda |

| ADD | MOVER | CARGA |

La instrucción LOAD está en la fase de almacenamiento, donde su resultado (el número 40) se almacenará en el registro A. Mientras tanto, se está ejecutando la instrucción MOVE. Como debe mover el contenido de A a B, debe esperar a que termine la instrucción LOAD.

| Reloj 4 | ||

| Carga | Ejecutar | Tienda |

| TIENDA | ADD | MOVER |

La instrucción STORE está cargada, mientras que la instrucción MOVE está terminando y la ADD está calculando.

Y así sucesivamente. Tenga en cuenta que, a veces, una instrucción dependerá del resultado de otra (como nuestro ejemplo MOVE). Cuando más de una instrucción hace referencia a una ubicación particular para un operando, ya sea leyéndolo (como entrada) o escribiéndolo (como salida), la ejecución de esas instrucciones en un orden diferente del orden original del programa puede llevar a la situación de peligro (mencionada anteriormente).

Tubería genérica de 4 etapas; las cajas de color representan instrucciones independientes entre sí

Una burbuja en el ciclo 3 retrasa la ejecución

Páginas relacionadas

- Tubería (informática)

- Computación paralela

- Paralelismo a nivel de instrucción

Preguntas y respuestas

P: ¿Qué es el pipelining de instrucciones?

R: La canalización de instrucciones es una técnica utilizada en el diseño de microprocesadores, microcontroladores y CPU modernos para aumentar el rendimiento de sus instrucciones dividiendo el procesamiento de una instrucción de CPU en una serie de pasos independientes con almacenamiento al final de cada paso.

P: ¿Cómo funciona el pipelining?

R: El pipelining funciona dividiendo la lógica en piezas más pequeñas e insertando flip flops entre las piezas de lógica, lo que reduce el tiempo necesario para que la lógica decodifique los valores hasta generar salidas válidas en función de estos valores. Esto permite periodos de reloj más rápidos.

P: ¿Cuáles son algunos ejemplos de canalizaciones?

R: Un ejemplo de canalización es la canalización RISC, que se divide en cinco etapas con un conjunto de flip flops entre cada etapa.

P: ¿Cómo aumenta el pipelining el rendimiento de las instrucciones?

R: El pipelining aumenta el rendimiento de las instrucciones al permitir que los módulos de la CPU trabajen en paralelo, lo que reduce el tiempo de inactividad durante un ciclo de instrucciones y aumenta el tiempo total de procesamiento.

P: ¿Están todos los pipelines completamente canalizados?

R: No, no todos los pipelines son completamente pipelines; algunos pipelines tienen ciclos de espera que retrasan el progreso en el pipeline.

Buscar dentro de la enciclopedia